10 anos de OpenAI: da promessa de salvar a humanidade ao império que não conseguiu apertar as mãos do rival

A empresa que nasceu como ONG para garantir que a IA beneficiasse todos completa uma década — mas o que sobrou dessa missão original?

Em dezembro de 2015, um grupo de pesquisadores e empreendedores do Vale do Silício — entre eles Elon Musk, Sam Altman, Ilya Sutskever e Greg Brockman — assinou os documentos de fundação de uma organização sem fins lucrativos com uma missão declaradamente ambiciosa: garantir que a inteligência artificial geral beneficiasse toda a humanidade. O nome era OpenAI. O charter original ainda existe. Mas a empresa que completa dez anos em 2025 é irreconhecível diante daquela promessa inicial — e uma cena ocorrida em Nova Delhi, em 19 de fevereiro de 2026, resume com precisão cirúrgica o quanto as coisas mudaram.

O começo: uma utopia cuidadosamente construída

A escolha pelo modelo de organização sem fins lucrativos não foi acidental. Era uma declaração de princípios: o lucro não poderia distorcer a missão. Com apoio inicial da Nvidia — que doou o supercomputador DGX-1 em 2016 — e anos de experimentos discretos com reinforcement learning e o OpenAI Gym, a organização construiu sua reputação na comunidade científica antes de qualquer produto de massa.

Em 2019, o lançamento do GPT-2 mudou o tom. A OpenAI chegou a hesitar em divulgá-lo publicamente, temendo o impacto de um modelo capaz de gerar texto convincente em escala industrial. Era, paradoxalmente, uma empresa criada para avançar a IA que temia as consequências de seu próprio avanço.

O ChatGPT e a ruptura com o modelo original

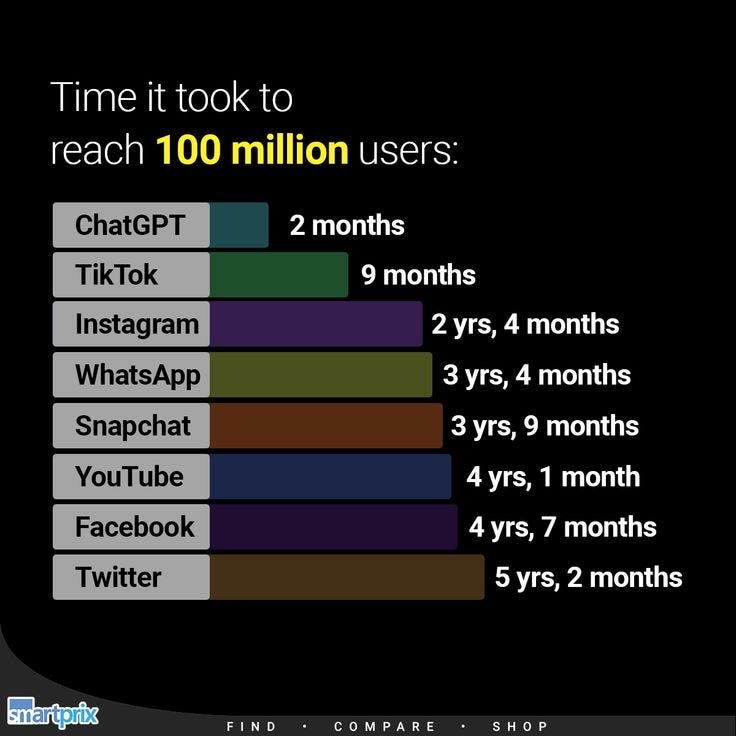

Novembro de 2022. O ChatGPT chega ao mundo e em dois meses atinge 100 milhões de usuários — a adoção mais rápida de qualquer produto na história da internet. O Google entra em “código vermelho”. A Microsoft despeja bilhões na empresa e integra seus modelos ao Bing, ao Office e ao Azure. E a OpenAI, silenciosamente, abandona o modelo de ONG pura para adotar uma estrutura de “capped profit” — lucro com limite, que foi sendo renegociado ao longo do tempo.

O limite, como se viu depois, era elástico.

A missão foi desvirtuada?

A lista de rupturas com a narrativa original é longa. Elon Musk saiu do conselho em 2018 alegando divergências sobre a direção da empresa — hoje é concorrente direto com o xAI e o Grok, e litiga na Justiça contra a OpenAI. Em novembro de 2023, Sam Altman foi demitido pelo próprio conselho e reintegrado em menos de uma semana, numa crise que expôs a tensão explícita entre os interesses de segurança e os interesses comerciais. Dario Amodei e outros pesquisadores-chave saíram da OpenAI por discordâncias e fundaram a Anthropic em 2021, posicionada como alternativa com foco em segurança.

E em 2026, a OpenAI anunciou publicidade no ChatGPT. Simbolicamente, é a maior ruptura possível com a narrativa original de uma organização construída para o bem comum.

Nova Delhi, 19 de fevereiro de 2026: a foto que vale mais que mil palavras

No India AI Summit, Sam Altman e Dario Amodei — os dois homens que antes compartilharam a mesma missão na OpenAI — aparecem lado a lado no palco, ao lado de Narendra Modi e outros líderes globais de IA. Modi levanta as mãos em gesto de unidade. Sundar Pichai e outros seguem. Altman e Amodei levantam os punhos separadamente, sem se tocar, sem se olhar.

Altman disse depois que estava “confuso” e “não sabia o que deveria fazer”. A internet, coletivamente, não acreditou.

O contexto adiciona ironia extra: a Anthropic havia lançado campanha no Super Bowl com os termos “traição”, “engano” e “violação” — referência amplamente interpretada como crítica à introdução de anúncios no ChatGPT. Altman respondeu chamando a Anthropic de “desonesta” e “autoritária”. E há um detalhe histórico que poucos mencionam: Amodei foi abordado pelo conselho da OpenAI para substituir Altman na crise de 2023. Recusou. Os dois nunca mais foram vistos como aliados.

O que os dez anos dizem sobre o futuro

A OpenAI hoje tem mais de 2.500 funcionários e uma avaliação na casa dos trilhões de dólares. A Anthropic, ironicamente, acaba de fechar rodada de US$ 30 bilhões e é avaliada em US$ 380 bilhões — o rival “ético” que também é um negócio bilionário. Ambas influenciam diretamente políticas de IA em múltiplos países. E ambas carregam, em seus documentos fundadores, a retórica do bem comum.

O charter original da OpenAI ainda existe. A missão de garantir que a AGI beneficie toda a humanidade ainda consta no papel. Mas o que ela significa quando a empresa disputa anunciantes, contratos militares e mercados emergentes?

Minha sincera opinião

Tenho pensado muito nessa questão desde que vi a foto de Nova Delhi. E a minha conclusão é desconfortável: acho que a missão original da OpenAI sempre teve um componente de narrativa estratégica — não necessariamente de má-fé, mas de uma visão de mundo genuinamente utópica que funcionou muito bem para atrair talentos e capital numa fase em que o produto ainda não existia.

Isso não invalida o trabalho técnico extraordinário que foi feito. Mas a trajetória da empresa — da ONG ao IPO projetado, dos princípios à publicidade — segue um padrão que já vimos antes no Vale do Silício: “move fast and break things”, incluindo suas próprias promessas.

O que me parece mais honesto é reconhecer que o problema não é a OpenAI ter “traído” sua missão. O problema é que criar AGI e distribuir seus benefícios para toda a humanidade é uma tarefa que não cabe dentro de uma empresa, independentemente de seus valores declarados. Esse é um problema de governança global — e nenhuma organização privada, por mais bem-intencionada que seja, vai resolver isso sozinha.

A foto em Nova Delhi é, no fundo, o retrato do estado atual da IA: muito poder, pouca coordenação, e dois ex-colegas que não conseguem nem fingir que se dão bem diante das câmeras. O futuro da IA será moldado por pessoas assim. Isso deveria nos preocupar — ou motivar. Depende, eu acho, de quanto você ainda acredita em missões.